プロダクト概要

製品の強み

適用シーン

--py-filesを使用して依存モジュールやファイルを指定します。--archivesを使用して仮想環境を指定します。--py-filesを使用して指定することをお勧めします。--archivesを使用すると、開発テスト環境全体を直接パッケージ化して使用できます。この方法はC関連の依存関係のコンパイルインストールをサポートしており、依存環境が比較的複雑な場合に推奨されます。--py-filesを使用して依存パッケージを指定します。pip install -i https://mirrors.tencent.com/pypi/simple/ <packages...> -t depcd depzip -r ../dep.zip .

--py-filesパラメータでパッケージ化されたdep.zipファイルを導入します。このファイルはCOSにアップロードするか、ローカルからアップロードする方法で導入できます。

python3 -m venv pyvenvsource pyvenv/bin/activate(pyvenv)> pip3 install -i [https://mirrors.tencent.com/pypi/simple/](https://mirrors.tencent.com/pypi/simple/) packages(pyvenv)> deactivatetar czvf pyvenv.tar.gz pyvenv/

conda create -y -n pyspark_env conda-pack <packages...> python=<3.9.x>conda activate pyspark_envconda pack -f -o pyspark_env.tar.gz

pyvenv.tar.gzをcosにアップロードします。bash pyspark_env_builder.sh -hUsage:pyspark-env-builder.sh [-r] [-n] [-o] [-h]-r ARG, the requirements for python dependency.-n ARG, the name for the virtual environment.-o ARG, the output directory. [default:current directory]-h, print the help info.

パラメータ | 説明 |

-r | requirements.txtの場所を指定 |

-n | 仮想環境の名前を指定、デフォルトは py3env |

-o | 仮想環境の保存先ローカルディレクトリを指定、デフォルトは現在のディレクトリ |

-h | ヘルプ情報を印刷 |

# requirement.txtrequests以下のコマンドを実行してくださいbash pyspark_env_builder.sh -r requirement.txt -n py3env

--archivesパラメータに仮想環境の完全なパスを入力し、#の後ろは解凍フォルダ名です。

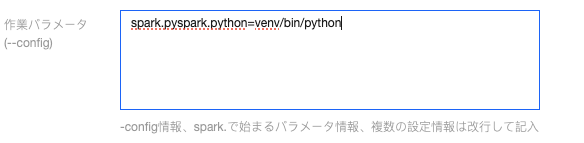

--configパラメータで実行環境パラメータを指定します。

spark.pyspark.python = venv/pyspark_venv/bin/python3を設定してください。spark.pyspark.python = venv/bin/python3を設定してください。spark.pyspark.python = venv/bin/python3を設定してください。フィードバック