Sparkパラメータは、Apache Sparkアプリケーションの設定を構成および調整するために使用されます。

自建のSparkでは、これらのパラメータはコマンドラインオプション、設定ファイル、またはプログラミング方式で設定できます。

DLC標準エンジンでは、エンジン上でSparkパラメータを設定でき、これらのパラメータはユーザーがSparkジョブを送信する際や、カスタム設定でインタラクティブSQLを送信する際に有効になります。

注意:

1. 標準エンジンエンジン次元の設定は、SparkジョブやBatch SQLタスクでのみ有効になります。

2. エンジン次元の設定を追加した後、新しいタスクが有効になります。

標準Sparkエンジンパラメータを設定

1. 標準エンジン機能に入ります。

2. リストページで設定するエンジンを選択します。

3. パラメータ設定をクリックすると、エンジンパラメータのサイドウィンドウが表示されます。

4. 「パラメータ設定」で追加をクリックし、ターゲット設定を追加した後、確認をクリックします。

リソースグループ次元のパラメータ設定

SQL分析リソースグループパラメータのみ

新規作成時にパラメータを追加

リソースグループを作成する際に「SQL分析のみ」を選択し、最後の「パラメータ管理」でパラメータの追加を選択します。

注意:

1. 静的パラメータはリソースグループの再起動後にのみ有効になり、動的パラメータはリソースグループの再起動なしで有効になります。

3. SQL分析リソースグループの設定は、そのリソースグループを使用してSQLタスクを実行する場合にのみ有効になります。

リソースグループパラメータを変更する

2. エンジンのリソースグループ管理ページで、SQL分析専用のリソースグループを選択し、詳細をクリックします。

3. 詳細ページで、構成管理モジュールの編集をクリックすると、パラメータを追加したり、既に追加されたパラメータを変更または削除したりできます。同様に、静的パラメータはリソースグループの再起動後にのみ有効になり、動的パラメータはリソースグループの再起動を必要としません。

4. 変更が完了したら保存をクリックします。この時、すぐに再起動するか、または単に保存してリソースグループを再起動せず、後で適切なタイミングでリソースグループを再起動して設定を有効にするかを選択できます。

AIリソースグループパラメータ

注意:

1. 現在、Spark MLlibタイプのAIリソースグループのみが設定の追加をサポートしています。

2. 現在は静的構成の追加のみサポートされており、構成は新しいnotebookセッションでのみ有効です。既存のセッションには適用されません。

3. AIリソースグループ機能はホワイトリスト機能です。ご利用シーンに適合することを確認するために、チケットを提出する ご連絡いただき、評価後に開通させていただきます。 4. このリソースグループは、Standard SparkエンジンStandard-S 1.1バージョンのみをサポートしています。

新規作成時にパラメータを追加

AIリソースグループを作成する際にSpark MLlibタイプを選択し、最後の「パラメータ管理」でパラメータの追加を選択します。

AIリソースグループパラメータを変更する

2. エンジンのリソースグループ管理ページで、Spark MLlibタイプのリソースグループを選択し、詳細をクリックします。

3. 詳細ページの構成管理モジュールで編集をクリックすると、パラメータを追加したり、既に追加されたパラメータを修正・削除したりできます。修正したパラメータは、修正後に起動したnotebook sessionでのみ有効となり、既存のsessionには適用されないことにご注意ください。

データ探索パラメータ

注意:

1. 現在、SQL分析リソースグループのみがデータ探索ページでパラメータを追加することをサポートしています。

2. 動的なspark設定のみが後続のSQL実行で有効になり、静的パラメータは有効になりません。

3. データ探索の設定は、エンジンレベルおよびリソースグループレベルのパラメータ設定よりも優先されます。

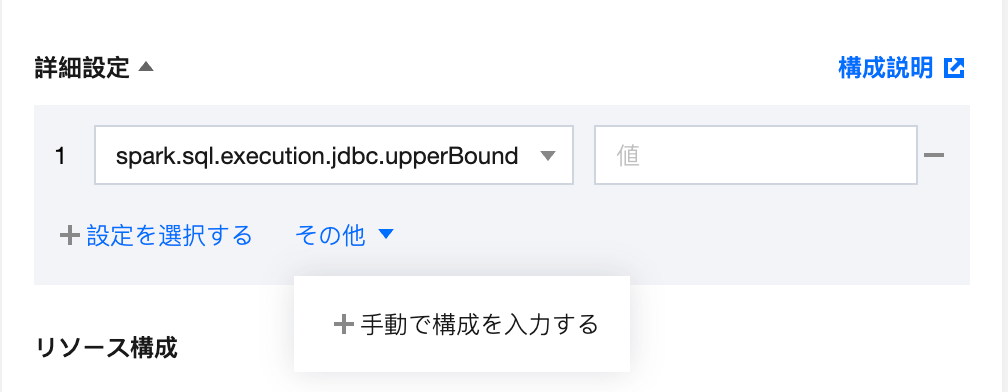

図のように、データ探索ページで、データエンジンに標準Sparkエンジンを選択し、リソース構成でリソースグループを選択し、ページ上で「詳細設定」を選択すると、設定を追加できます。

図のように、組み込みの設定を選択することも、手動で設定を入力することもできます。

Sparkジョブパラメータ

注意:

1. ジョブパラメータの変更は、後続で起動するジョブにのみ適用され、すでに実行中のジョブには適用されません。

2. ジョブパラメータはエンジンレベルのパラメータよりも優先されます。

新規作成時にパラメータを追加

データジョブに移動し、ジョブの作成をクリックして、ジョブパラメータにパラメータを追加します。 既存ジョブのパラメータを編集

1. データジョブをクリックし、既存のジョブを選択して、編集をクリックします。 2. ジョブ編集ページでジョブのパラメータを変更し、変更が完了したら変更を完了をクリックします。