HDFS 数据源

Download

聚焦模式

字号

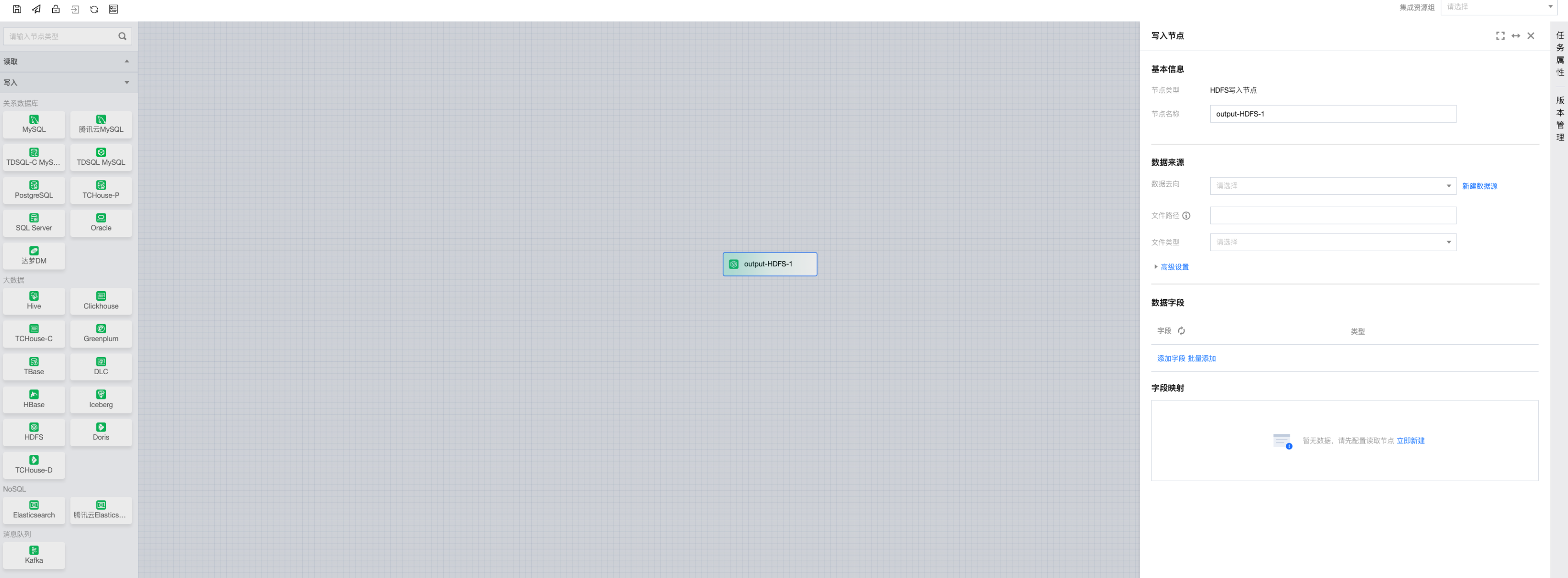

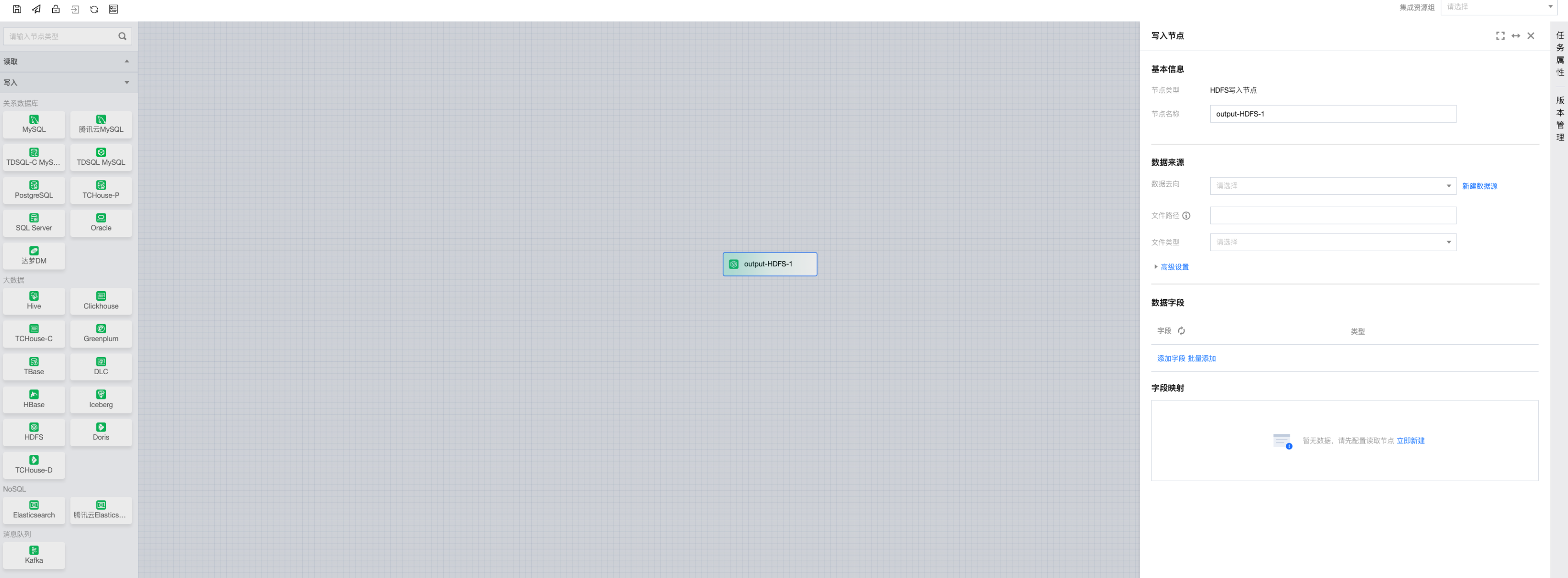

HDFS 单表写入节点配置

1. 在数据集成页面左侧目录栏单击实时同步。

2. 在实时同步页面上方选择单表同步新建(可选择表单和画布模式)并进入配置页面。

3. 单击左侧写入,单击选择 HDFS 节点并配置节点信息。

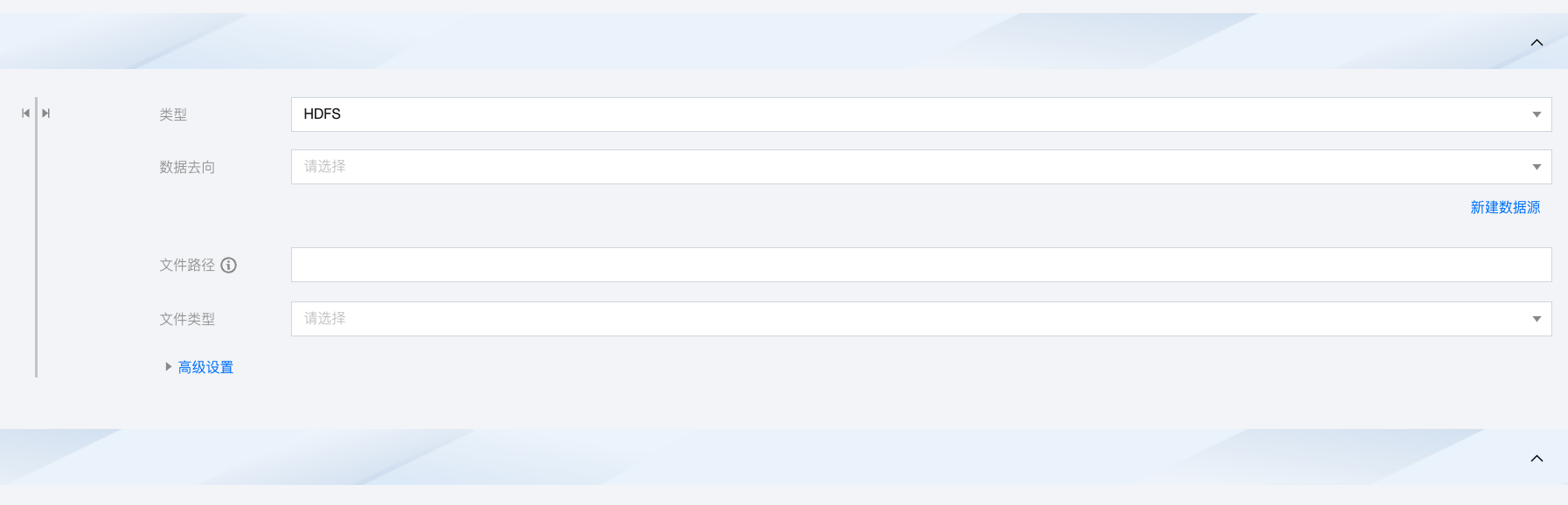

4. 您可以参考下表进行参数信息配置。

参数 | 说明 |

数据去向 | 选择当前项目中可用的 HDFS 数据源。 |

文件路径 | 文件系统的路径信息。路径支持使用‘*’作为通配符,指定通配符后将遍历多个文件信息。 |

文件类型 | HDFS 支持四种文件类型:txt 、orc 、parquet 、csv。 txt:表示 TextFile 文件格式。 orc:表示 ORCFile 文件格式。 parquet:表示普通 Parquet 文件格式。 csv:表示普通 HDFS 文件格式(逻辑二维表)。 |

高级设置 | 可根据业务需求配置参数。 |

5. 预览数据字段并与读取节点配置字段映射,单击保存。

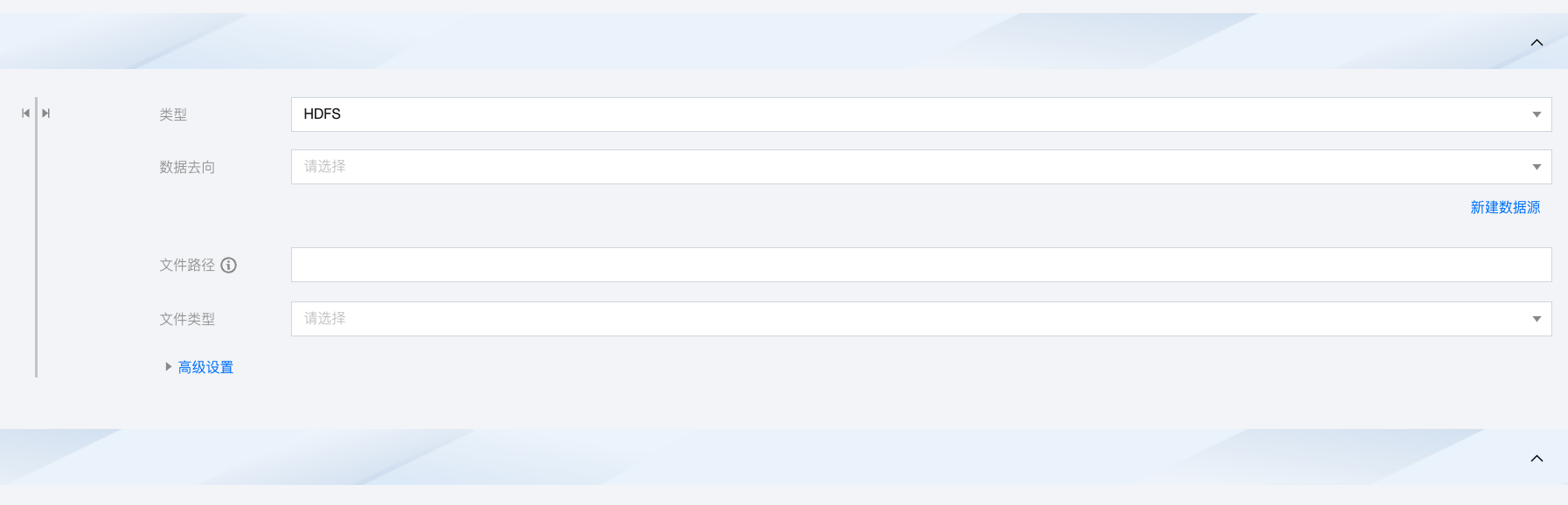

HDFS 日志采集写入节点配置

参数 | 说明 |

数据去向 | 选择当前项目中可用的 HDFS 数据源。 |

文件路径 | 文件系统的路径信息。路径支持使用‘*’作为通配符,指定通配符后将遍历多个文件信息。 |

文件类型 | HDFS 支持四种文件类型:txt 、orc 、parquet 、csv。 |

高级设置(可选) | 可根据业务需求配置参数。 |

文档反馈