查询脚本分析

Download

聚焦模式

字号

为方便用户快速处理重复的查询工作任务,数据湖计算 DLC 为用户提供了脚本文件分析。

说明

控制台中允许保存最多100个 SQL 脚本。

新建查询目录

1. 登录 数据湖计算 DLC 控制台 > 脚本查询页面。

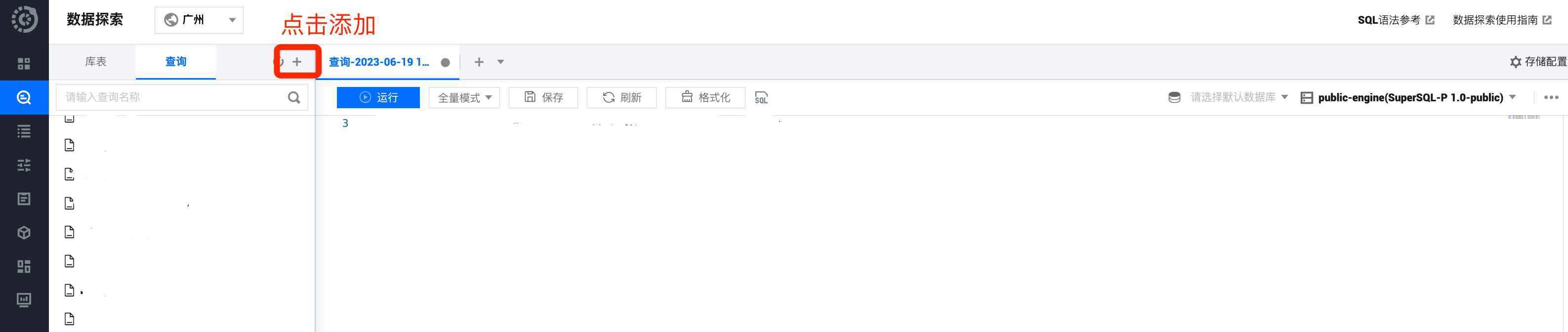

2. 在查询页面中,单击添加查询目录。

3. 填写目录配置后,即可保存完成创建。

目录名称:支持中文、英文及“_”,最多25个字符。

权限设置:可根据工作组或用户视角,对该脚本目录及目录下的脚本,设置可见权限。

新建查询脚本

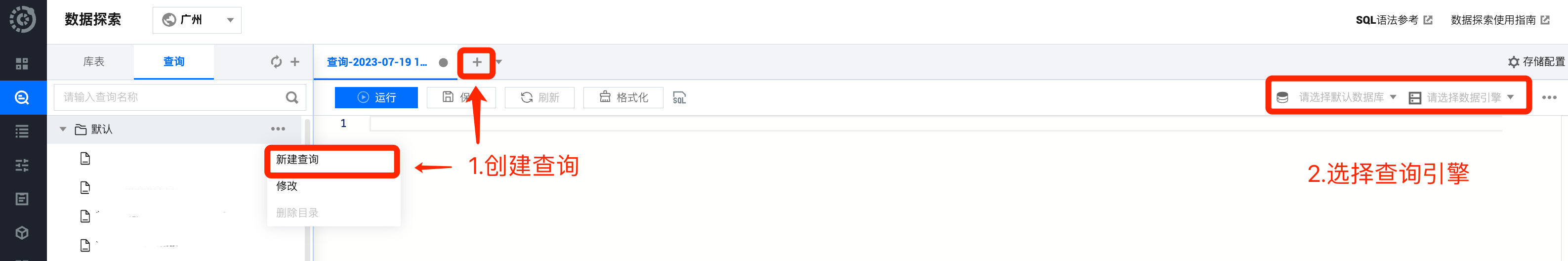

1. 登录 数据湖计算 DLC 控制台 > 脚本查询页面,可通过点击库

2. 选择计算引擎后,单击运行即可执行脚本。

保存查询脚本

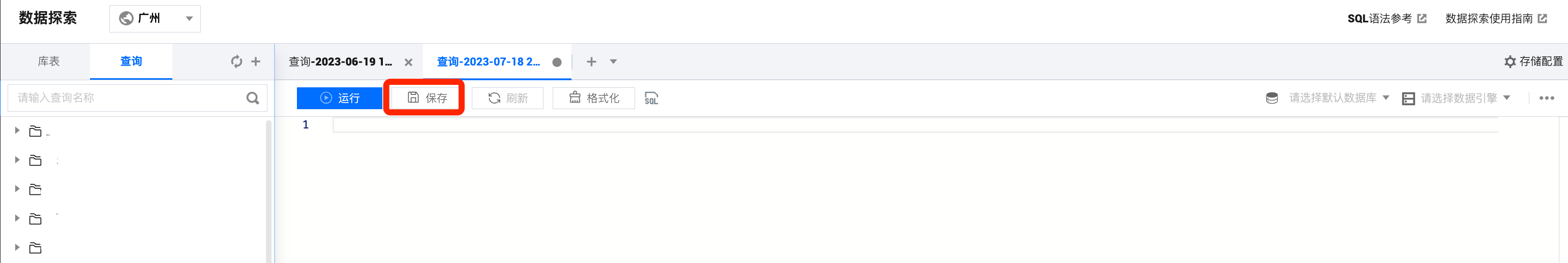

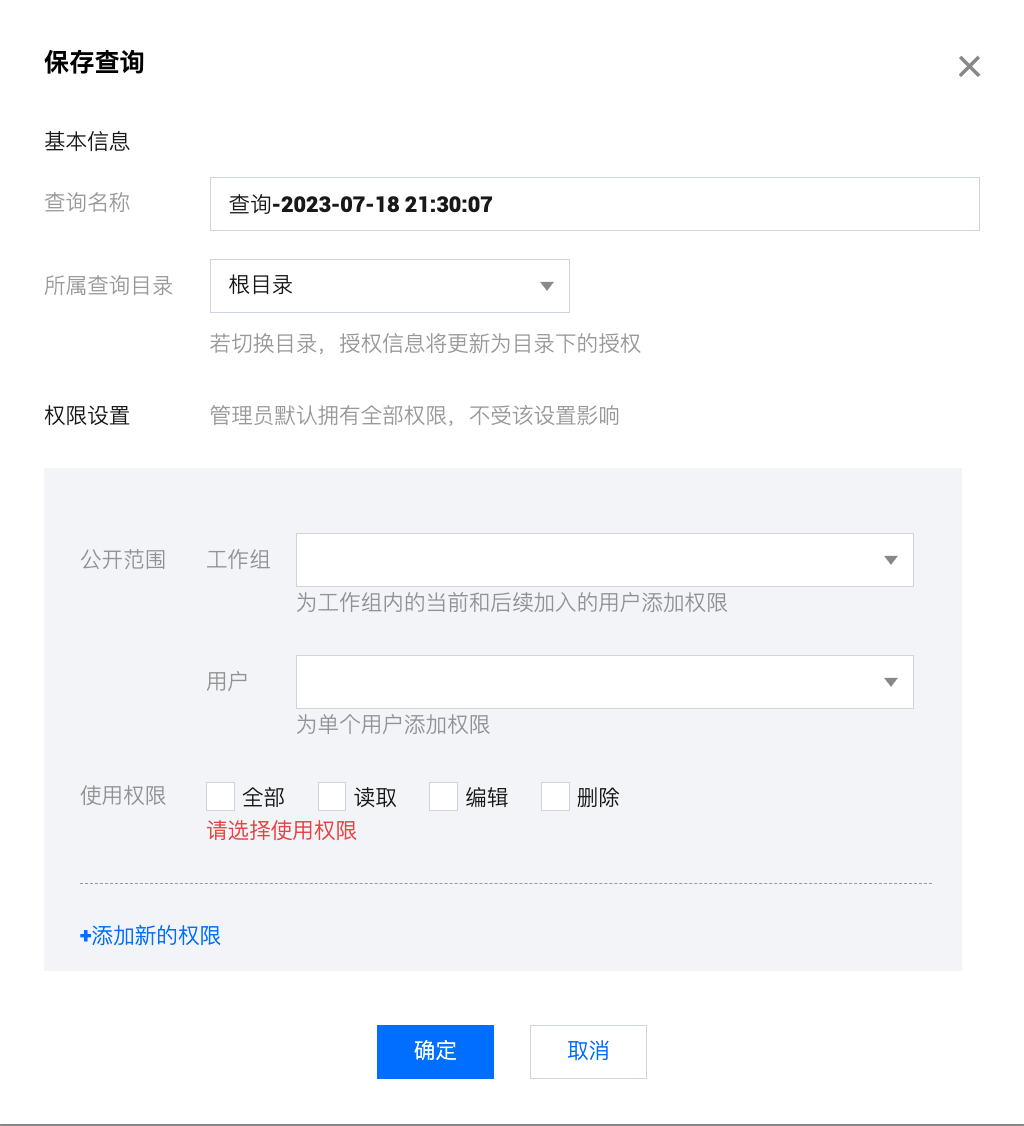

1. 查询完成后,单击“保存”按钮。

2. 通过库创建的查询,会保存在该库的目录下。通过 tab 栏添加查询的可直接存在根目录下或选择有权限的库保存。

3. 查询表的权限根据库的公开范围自定义选择,同时支持针对公开范围制定表的使用权限。

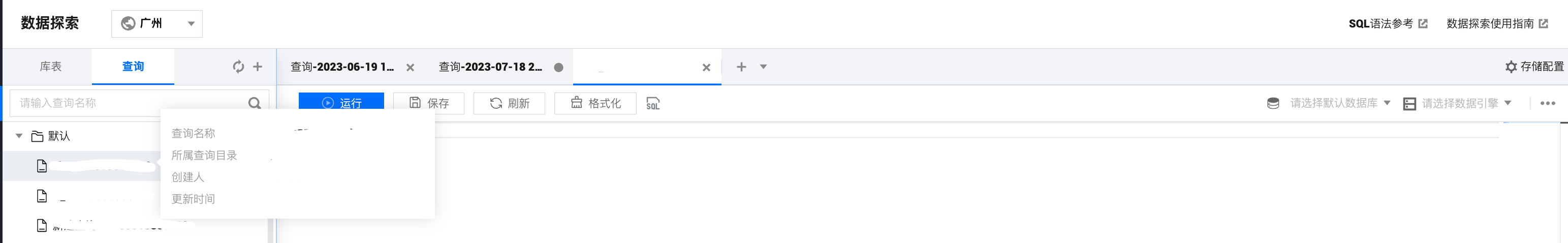

查看脚本信息

1. 鼠标悬停到需要查看的脚本名称,即可查看脚本详情信息。

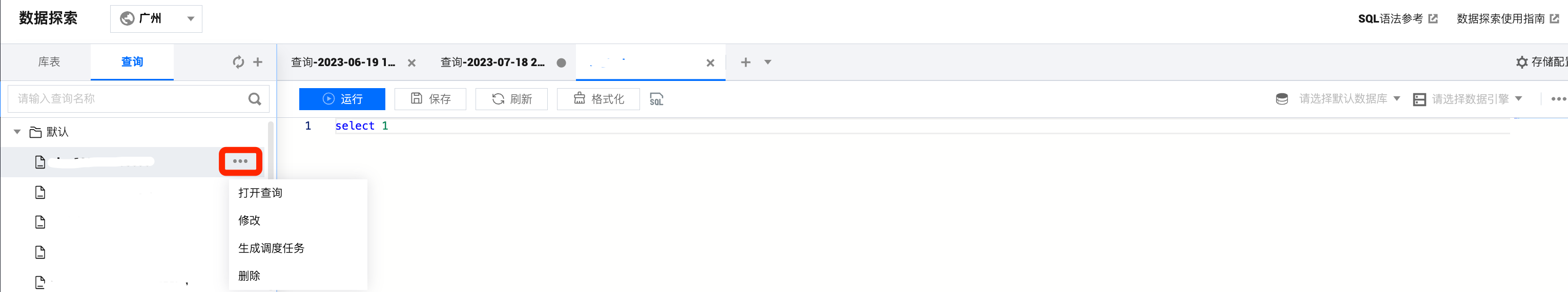

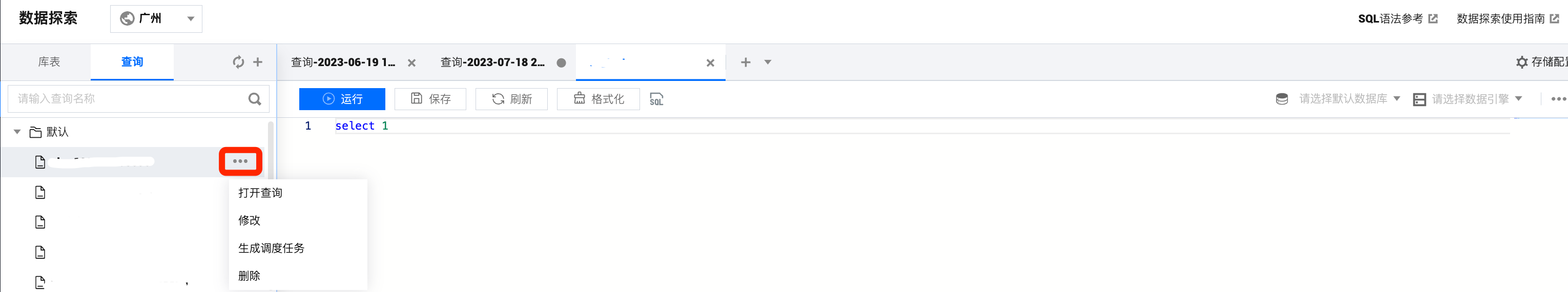

2. 单击需要查看的表旁的

删除查询脚本

单击需要删除的表旁的

注意:

脚本删除后将无法恢复,请谨慎操作。

文档反馈