函数管理

Download

聚焦模式

字号

数据湖计算 DLC 中支持使用用户自定义函数对数据进行处理构建,并支持管理函数。

创建函数

1. 登录 数据湖计算 DLC 控制台,选择服务地域,登录账号需具备数据库操作权限。

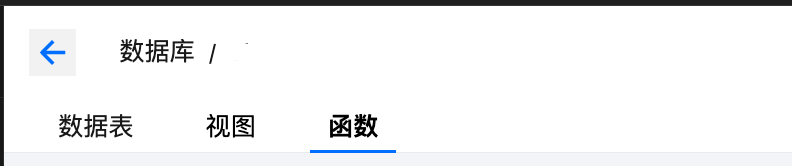

2. 入口一:进入元数据管理页,切换至数据库页面,单击需要构建函数的数据库名称,进入后切换至函数页面。

3. 单击创建函数按钮,进入函数创建菜单。

函数包支持本地上传或使用 COS 上已有的 JAR、Python,本地上传 JAR 文件最大支持5M,Python 文件最大支持2M。

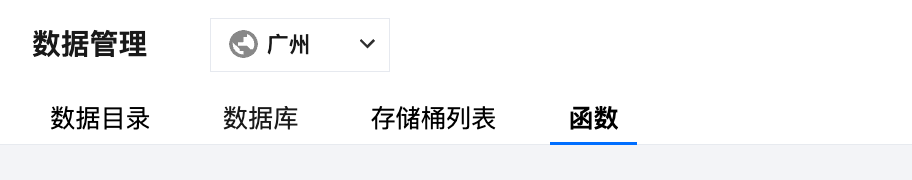

Python 注册 UDF 为全局生效,配置入口为:进入数据管理页,切换至函数页点击创建。创建及管理流程可参考 UDF 函数开发指南。

需选择 Spark 集群进行运行,运行过程中将不会产生任何费用。

建议将函数包保存到系统,方便对函数包进行管理及使用。同时也支持挂载至指定 COS 路径。

查看函数信息

1. 登录 数据湖计算 DLC 控制台,登录账号需具备数据库操作权限。

3. 选择函数,即可查看函数的构建状态,若构建失败可点击右侧编辑按钮后再次提交。

4. 单击函数名称可直接查看函数详情信息。

编辑函数信息

1. 登录 数据湖计算 DLC 控制台,选择服务地域,登录账号需具备数据库操作权限。

2. 进入元数据管理页,单击需要查看函数的数据库名称。

3. 选择函数,单击编辑按钮进入函数信息编辑页面。

暂不可修改函数名称、存储方式以及上传方式,如需修改此类信息可重新创建函数。

修改函数信息后,将进行重新构建,请谨慎操作。

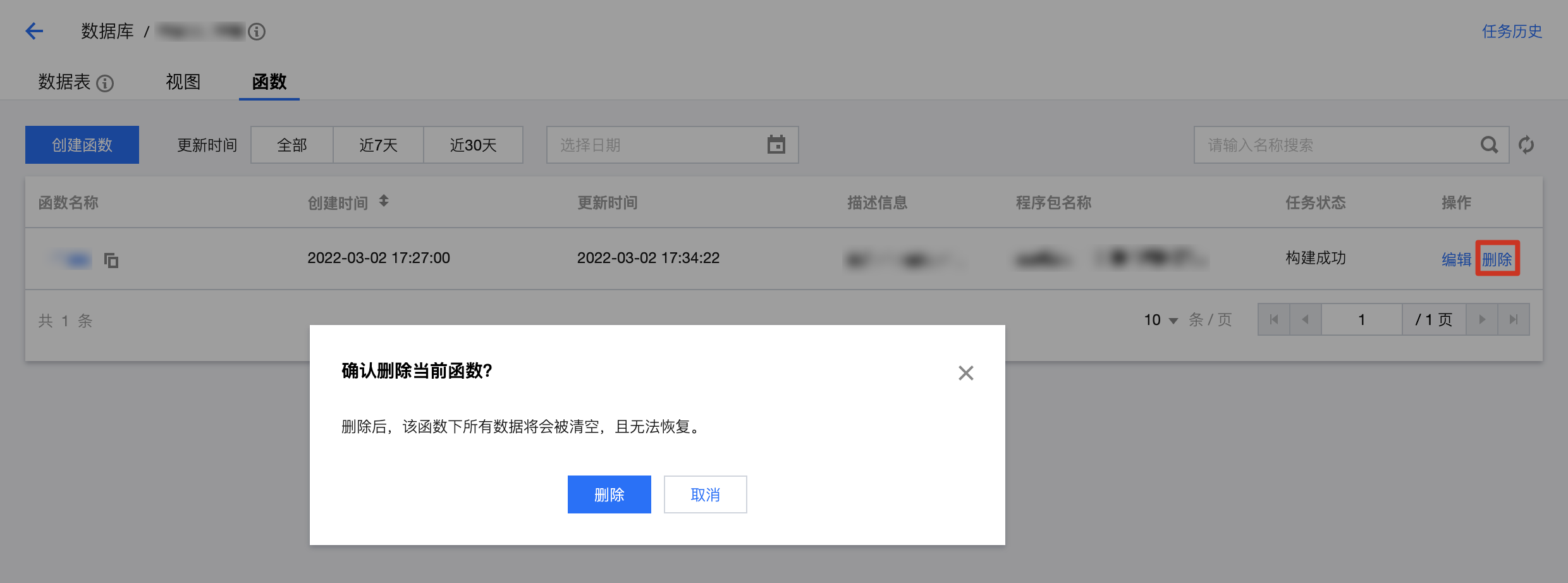

删除函数

针对无需继续使用管理的函数,可对函数进行删除操作。

1. 登录 数据湖计算 DLC 控制台,选择服务地域,登录账号需具备数据库操作权限。

2. 进入元数据管理,单击需要查看函数的数据库名称。

3. 选择函数,单击删除按钮对无需继续使用的函数进行删除。

注意:

删除后该函数下的数据将会被清空,且无法恢复,请谨慎操作。

文档反馈