历史记录(旧)

Download

聚焦模式

字号

为了方便用户查询历史任务记录,数据湖计算 DLC 提供了3种途径对历史任务进行查询处理。

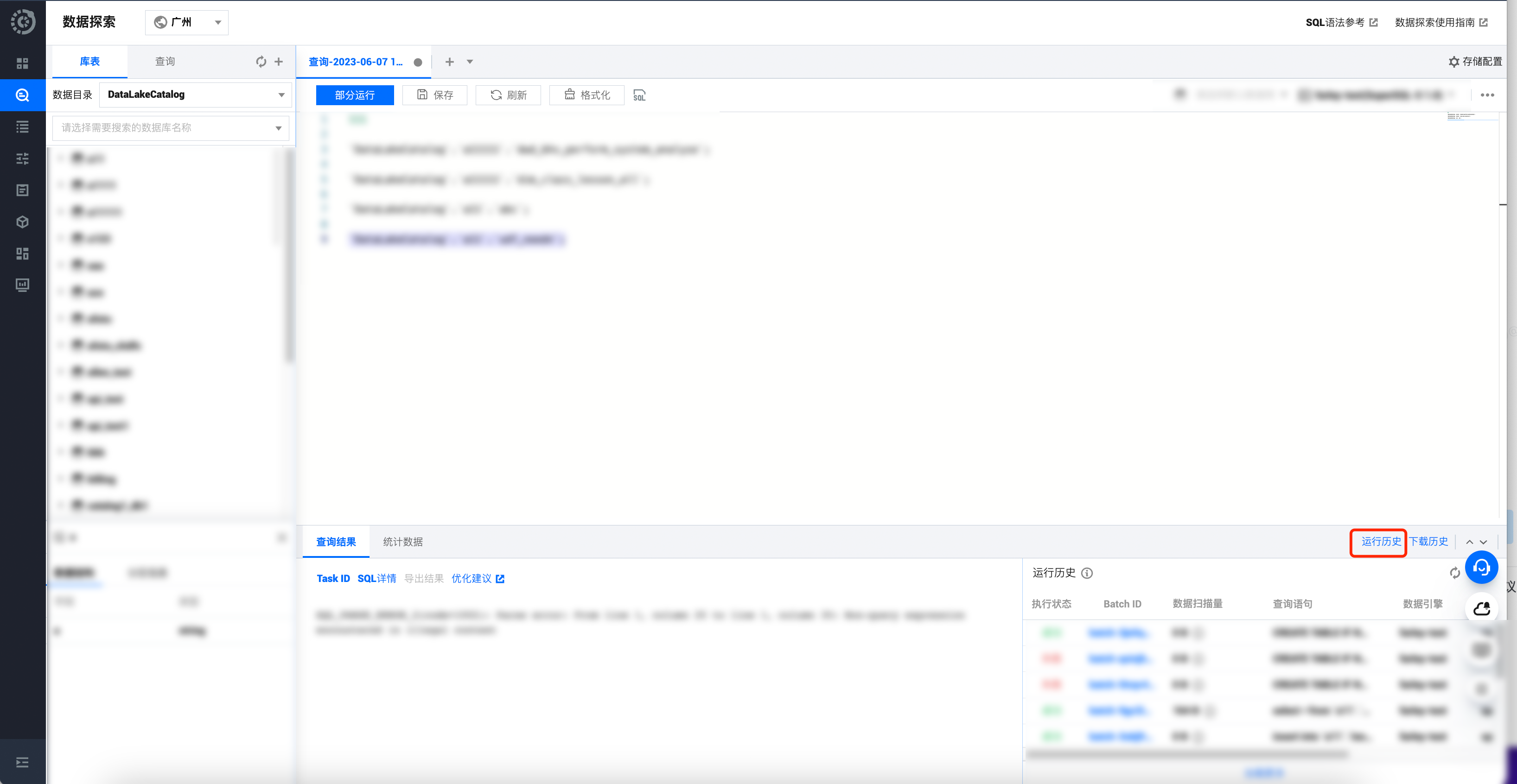

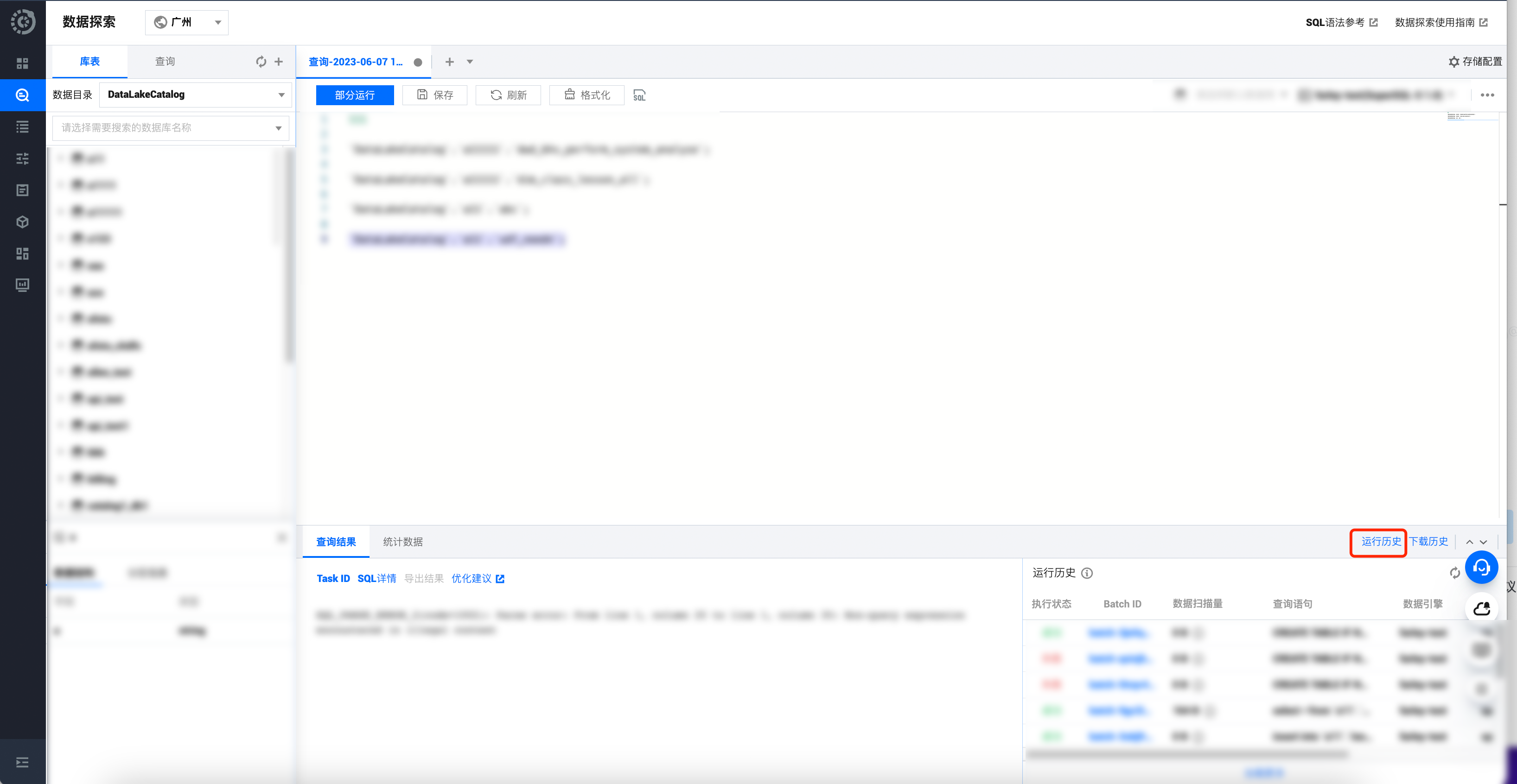

查询编辑器中查看运行历史任务

1. 登录 数据湖计算 DLC 控制台,选择服务地域。

2. 进入数据探索页面,在单个 Session 内单击运行历史即可查看该 Session 下的任务运行历史记录。

3. 单击历史记录 Batch ID 即可在左侧查看对应的运行结果

每个 Session 的运行历史独立,最多保存45天的运行历史记录。

历史任务结果数据保存24小时,如需查看超过24小时的任务结果,需重新运行任务。

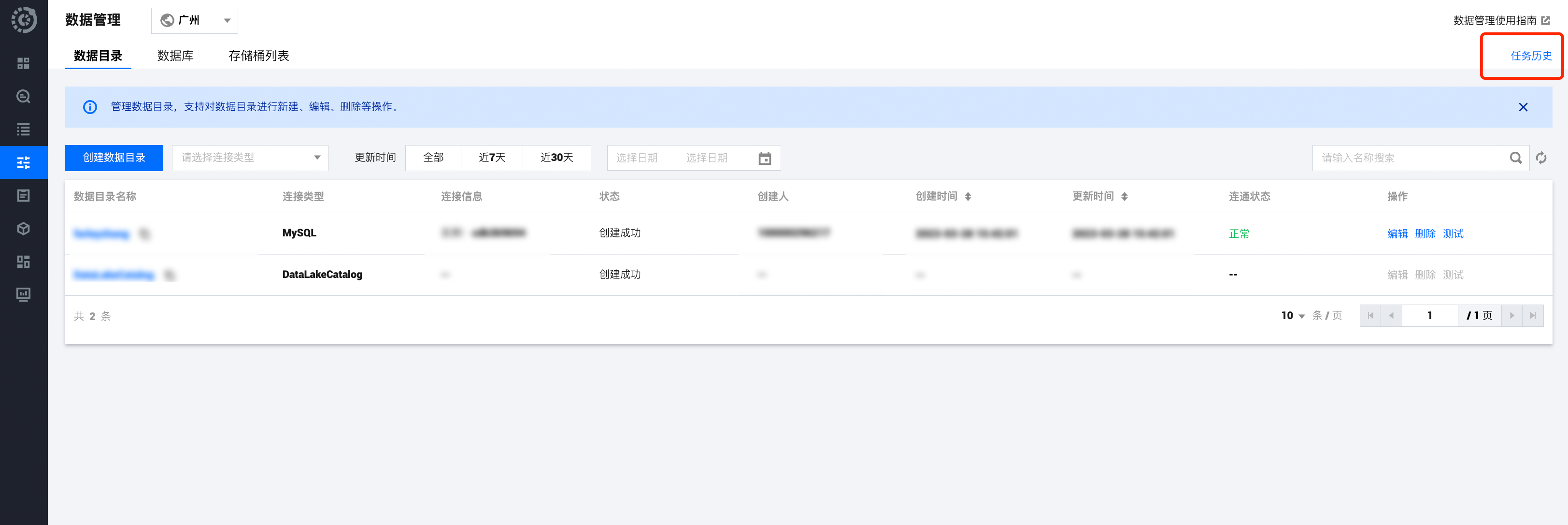

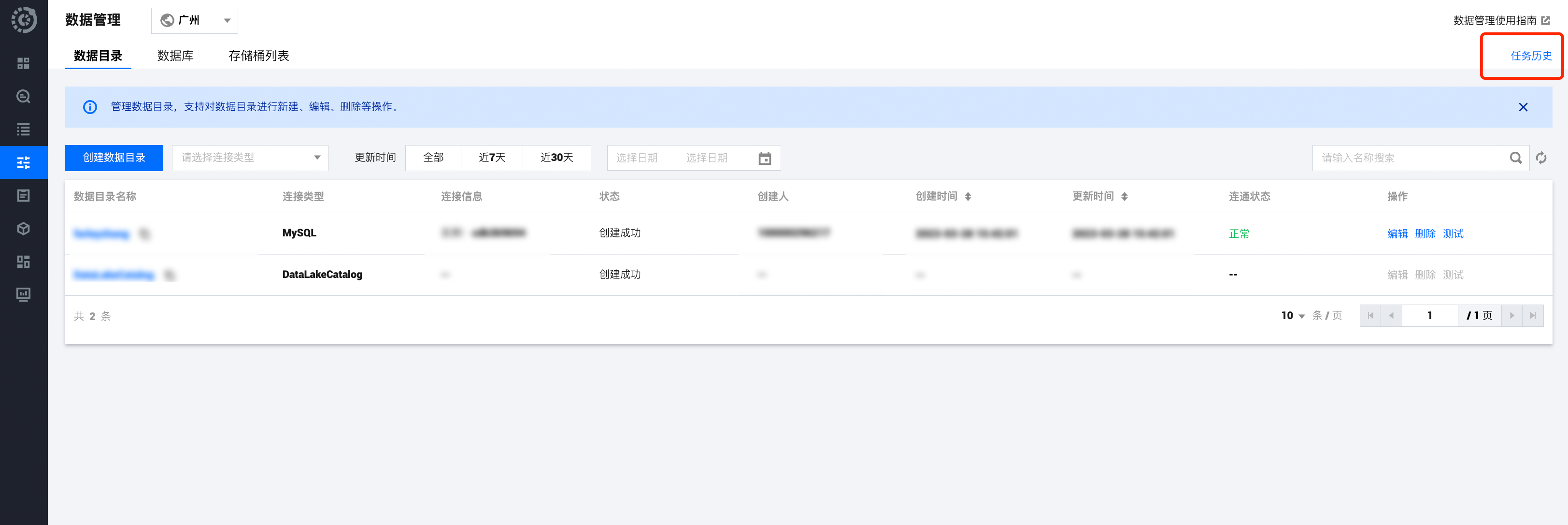

数据管理功能中查看数据导入历史

1. 登录 数据湖计算 DLC 控制台 > 数据管理,选择服务地域。

注意:

登录账号需要有数据库相关权限。

2. 单击右上角的任务历史即可查询数据导入历史任务。

3. 支持查看近45天的历史任务

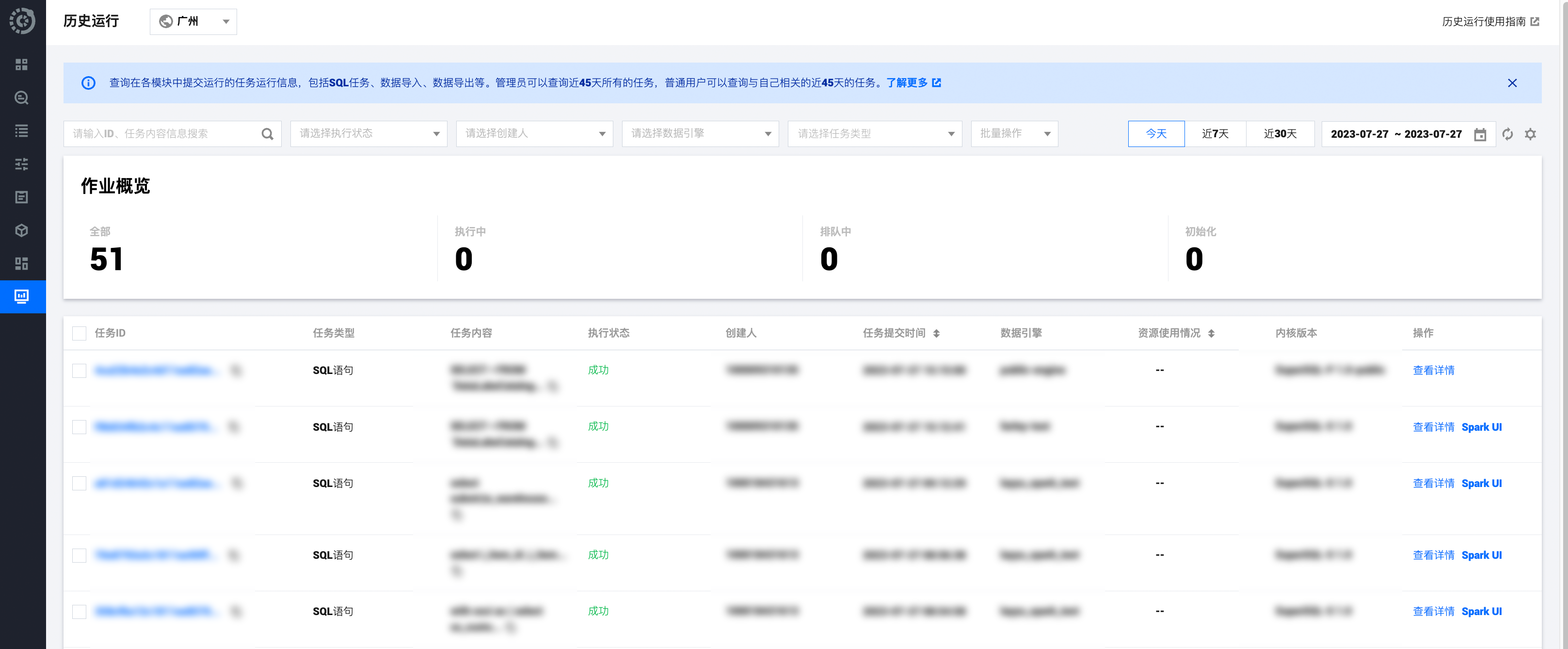

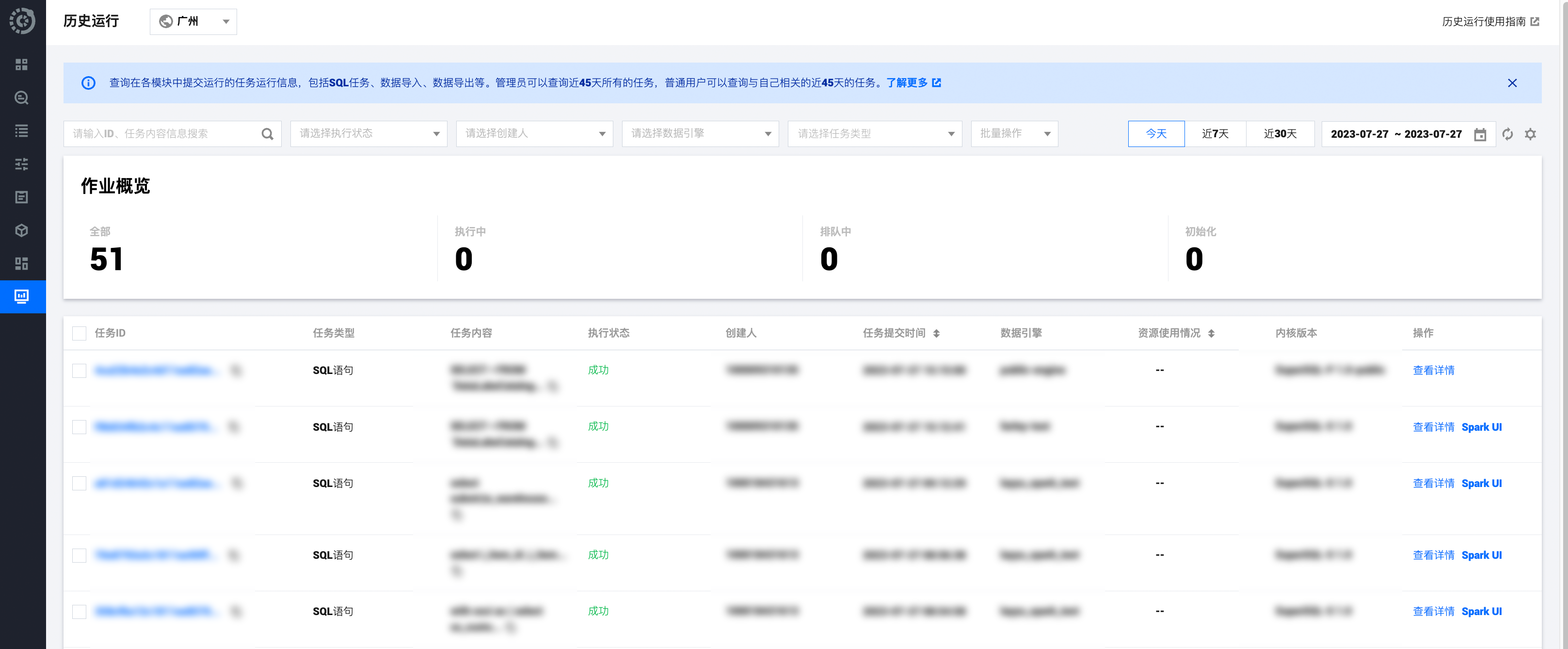

历史运行功能中查看历史任务

1. 登录 数据湖计算 DLC 控制台 > 历史运行,选择服务地域。

2. 进入历史运行页面,管理员可查看近45天所有的历史运行任务,普通用户可查询与自己相关的近45天的任务。

3. 支持对任务类型、执行状态、创建人、数据类型等方式的筛选查看。

4. 单击查看详情,可查看任务运行详情及任务运行结果。

历史任务结果数据保存24小时,如需查看超过24小时的任务结果,需重新运行任务,可直接复制语句至数据探索进行任务运行。

可直接单击任务 ID 快速切换查看任务运行详情。

运行中的任务,可对任务进行取消操作。

文档反馈