引擎级别参数设置

Download

聚焦模式

字号

说明:

目前支持 SparkSQL 引擎、Spark 作业引擎设置引擎。

Spark 参数是用来配置和调优 Apache Spark 应用程序的设置。在自建的 Spark 中这些参数可以通过命令行选项、配置文件或编程方式进行设置。在 DLC 中,您可以在 SparkSQL 引擎和 Spark 作业引擎的 SQL 和代码中指定 Spark 参数,也可以直接设定引擎维度的参数,引擎级别的 Spark 参数设置如下。

设置引擎级别参数

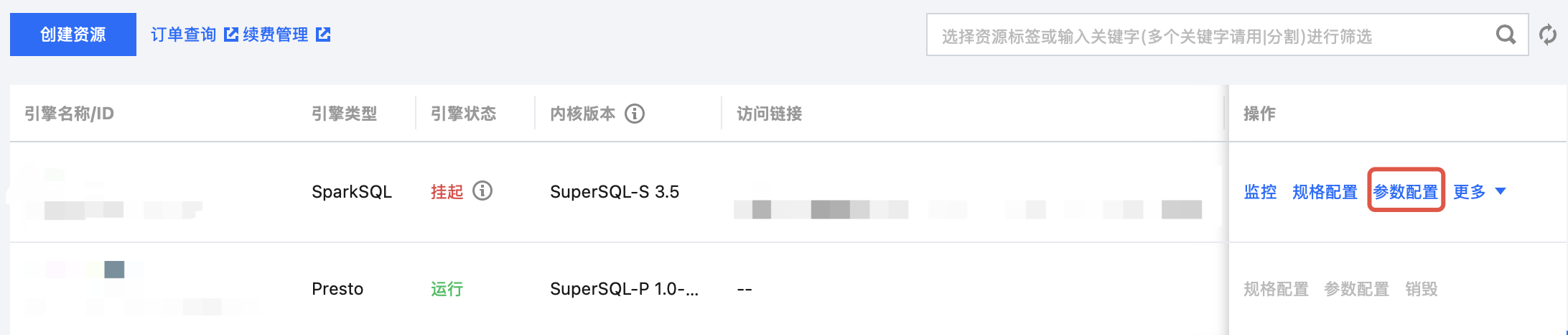

1. 进入 SuperSQL引擎 模块,单击参数配置,弹出引擎参数侧拉窗。

2. Spark 作业引擎下,您可以配置作业默认资源规格和参数。SparkSQL 引擎下无需关注作业默认资源规格。

使用引擎级别参数

Spark 作业引擎使用引擎级别参数

创建数据作业时,默认会继承引擎级别的参数和资源配置。您可以通过作业参数(--config)覆盖引擎级别参数,并选择是否继承引擎级别的资源配置。选中默认配置时,将使用引擎级别的资源配置。

数据探索使用 Spark 作业引擎运行 SQL 时,默认会继承引擎级别的参数和资源配置。您可以通过 SQL 中的 set 命令覆盖引擎级别参数,并选择是否继承引擎级别的资源配置。

SparkSQL 引擎使用引擎级别参数

SparkSQL 引擎没有引擎级别资源参数,任务会尽可能用满集群资源。目前 SparkSQL 引擎需要在数据探索中提交 SQL。数据探索使用 SparkSQL 引擎运行 SQL 时,默认会继承引擎级别的参数,您可以通过 SQL 中的 set 命令覆盖引擎级别参数。

文档反馈