配置公网访问标准引擎

Download

聚焦模式

字号

通过给执行机绑定公网IP,可以从公网访问标准引擎。

步骤1:创建终端节点

1. 登录 数据湖计算 DLC 控制台,单击左侧菜单标准引擎,进入标准引擎界面,单击网关详情按钮进入详情界面。

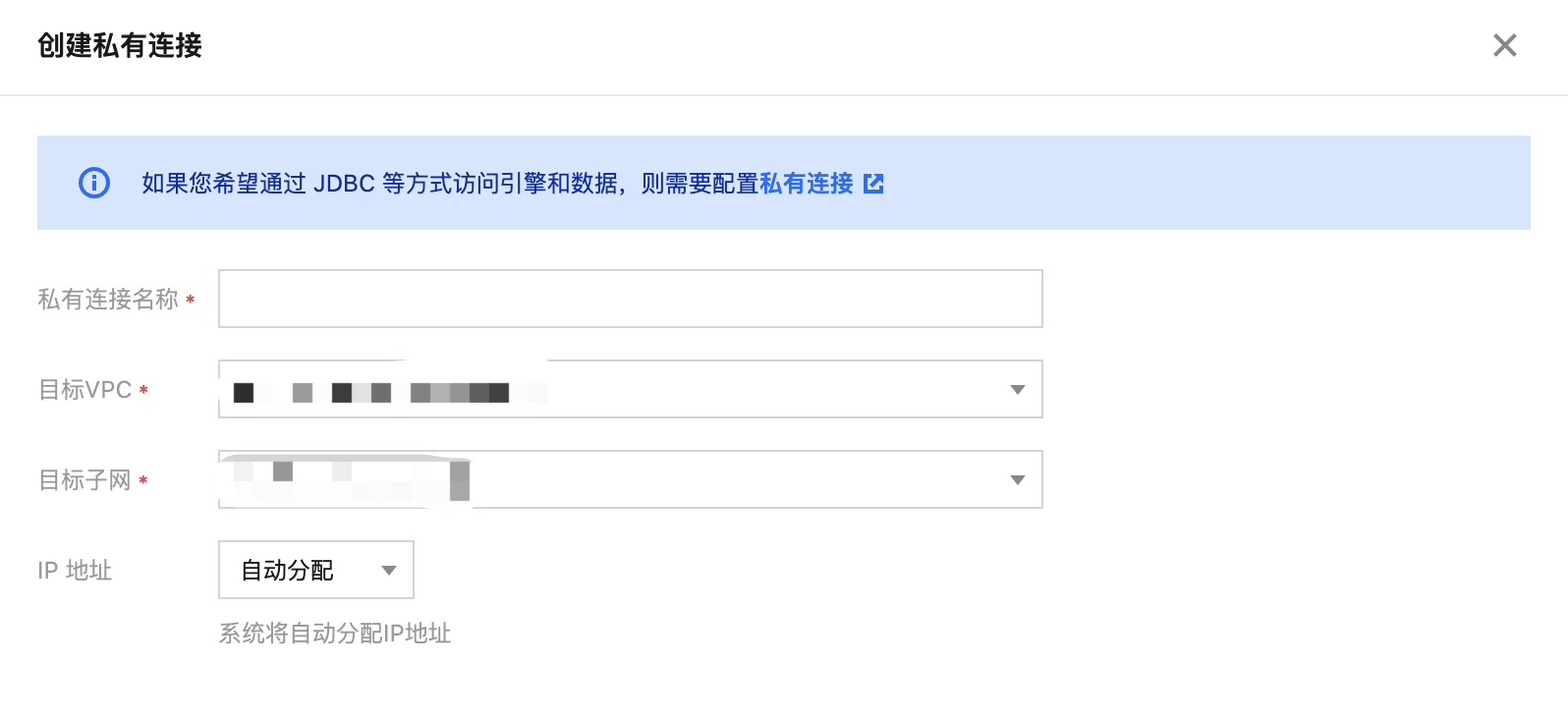

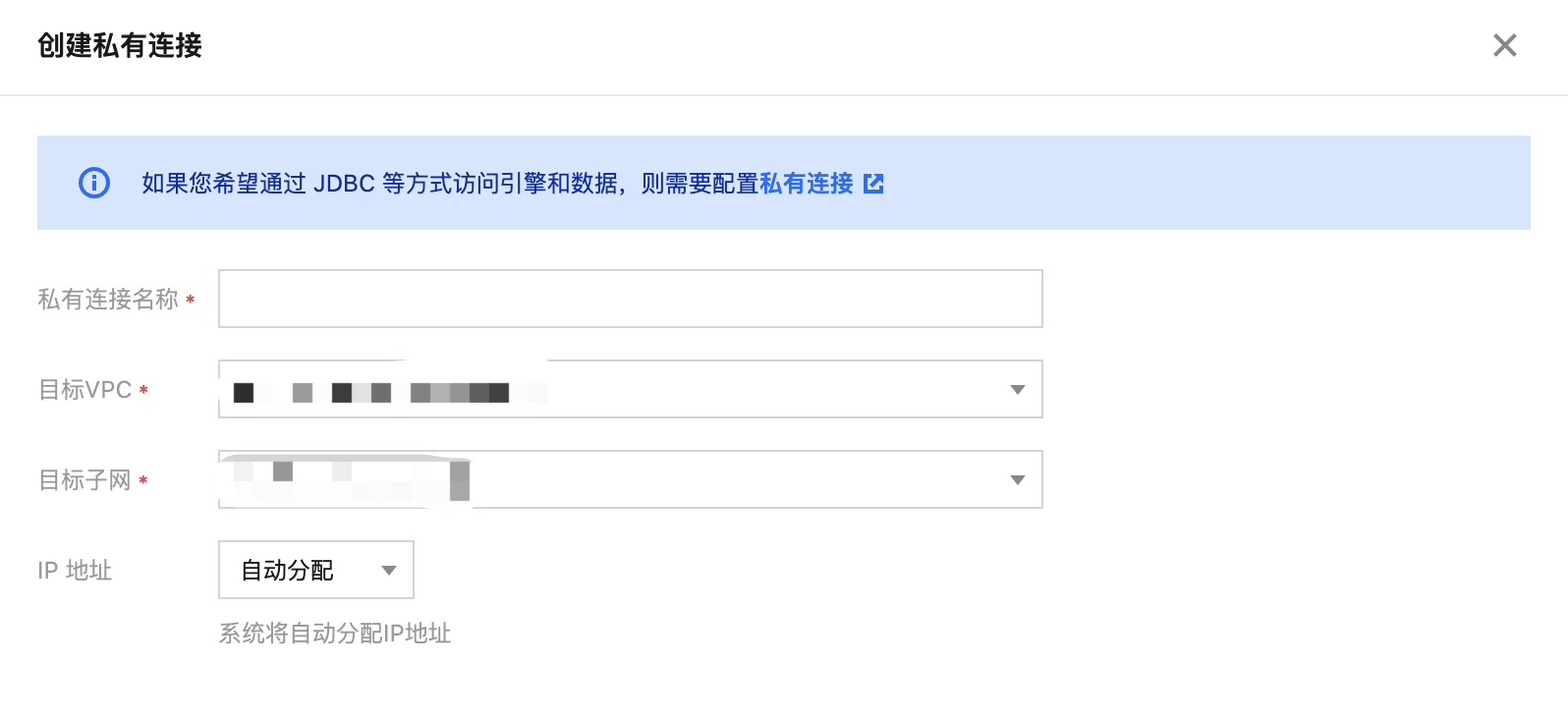

在访问管理详情页面点击创建私有连接按钮:

2. 进入创建私有连接界面,选择目标 VPC 和目标子网,其中目标 VPC 和目标子网选择您账号下用户和接入点、引擎通信的一个 VPC。

步骤2:创建执行机并开通公网访问

如果没有执行机,请先购买一台 CVM 作为执行机。

1. 进入腾讯云云服务器 。在对应地域单击新建 。

2. 执行机需要创建在步骤1中打通终端节点的私有网络的子网下:

给该执行机分配一个公网 IP。

所选安全组要放通了特定的网段和端口。

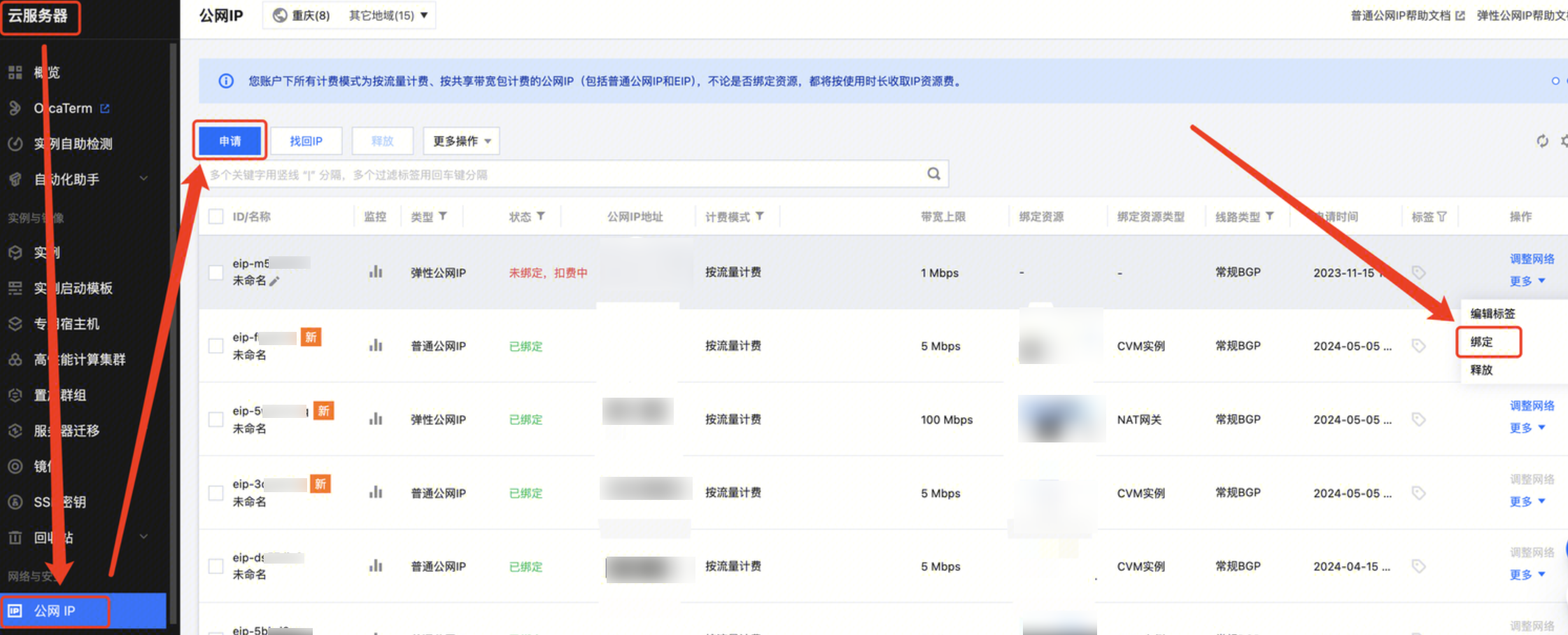

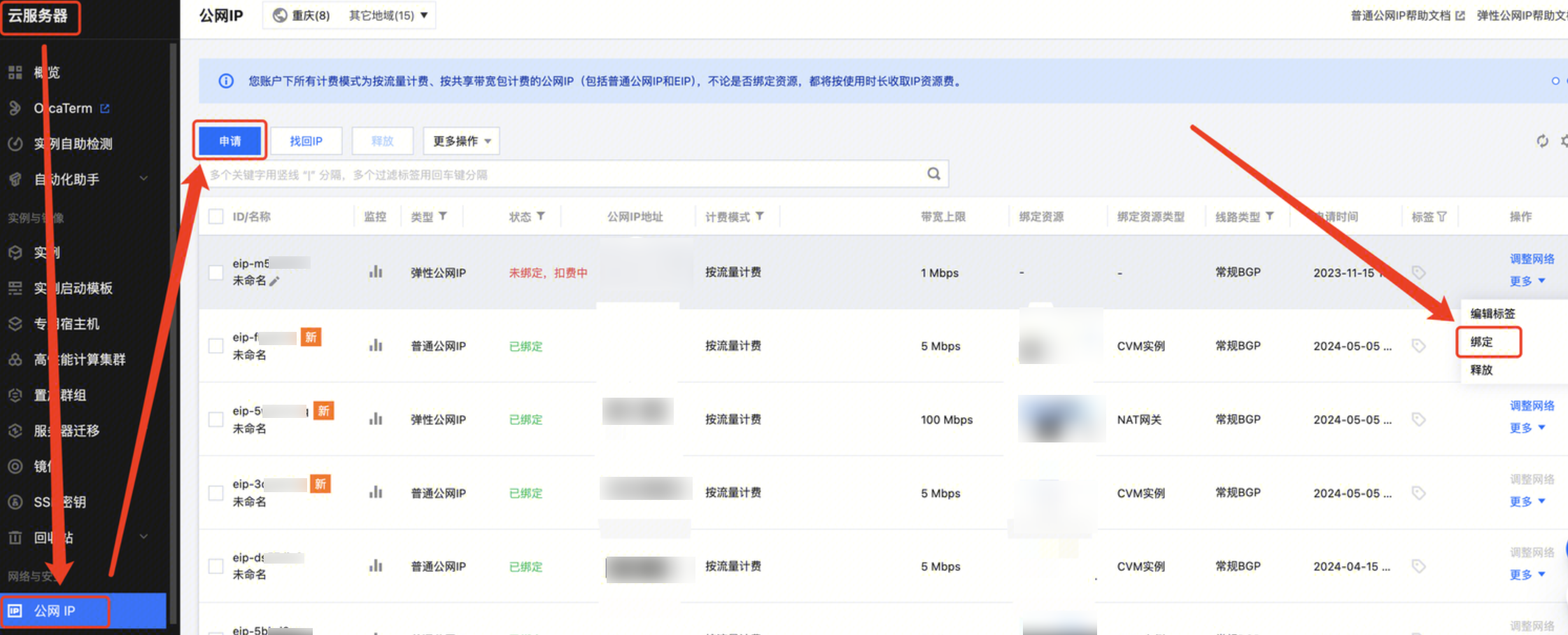

步骤3:执行机绑定公网 IP

如果是已有的 CVM 作为执行机,但 CVM 上面没有弹性公网IP,可以新建一个弹性公网 IP 并绑定到步骤2中创建的执行机上:

步骤4:修改执行机的 iptables

1. 登录执行机,在执行机上面执行以下指令:

echo 1 > /proc/sys/net/ipv4/ip_forwardecho 0 > /proc/sys/net/ipv4/conf/all/rp_filteriptables -t nat -A PREROUTING -p tcp --dport 10999 -j DNAT --to $endPointIp:10999iptables -t nat -A PREROUTING -p tcp --dport 10009 -j DNAT --to $endPointIp:10009iptables -t nat -A POSTROUTING -j MASQUERADEiptables -t nat -L -n -v

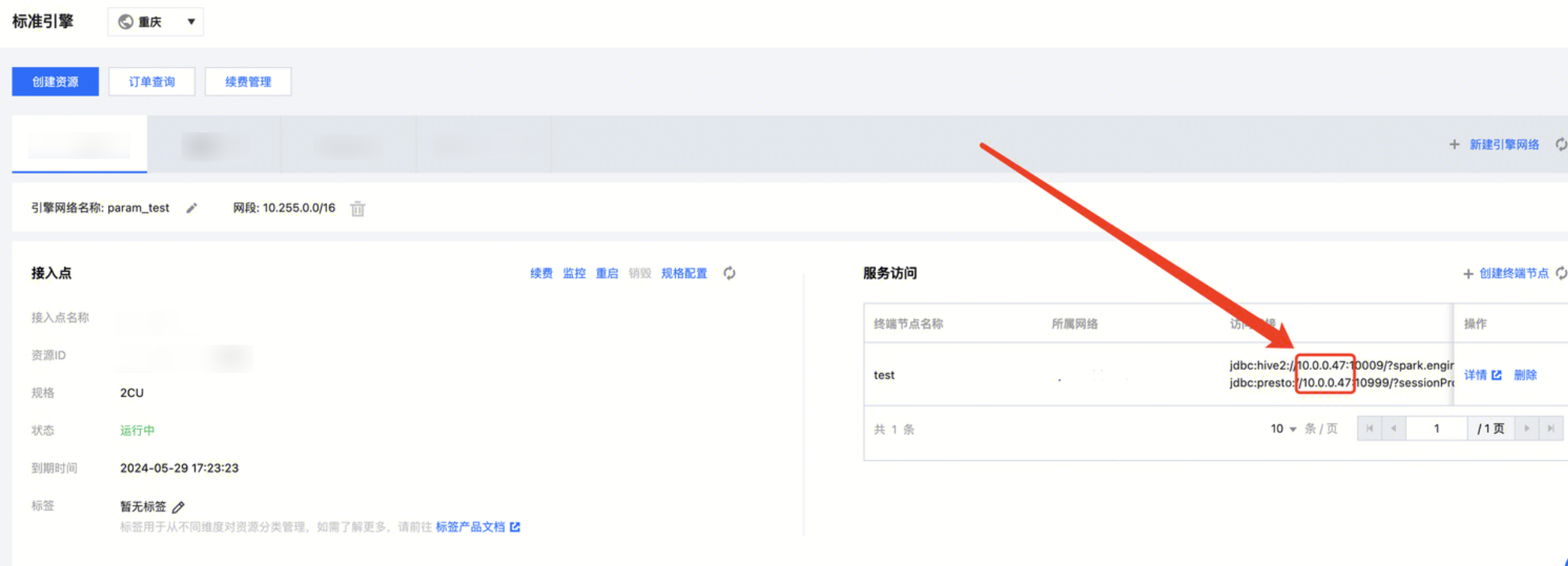

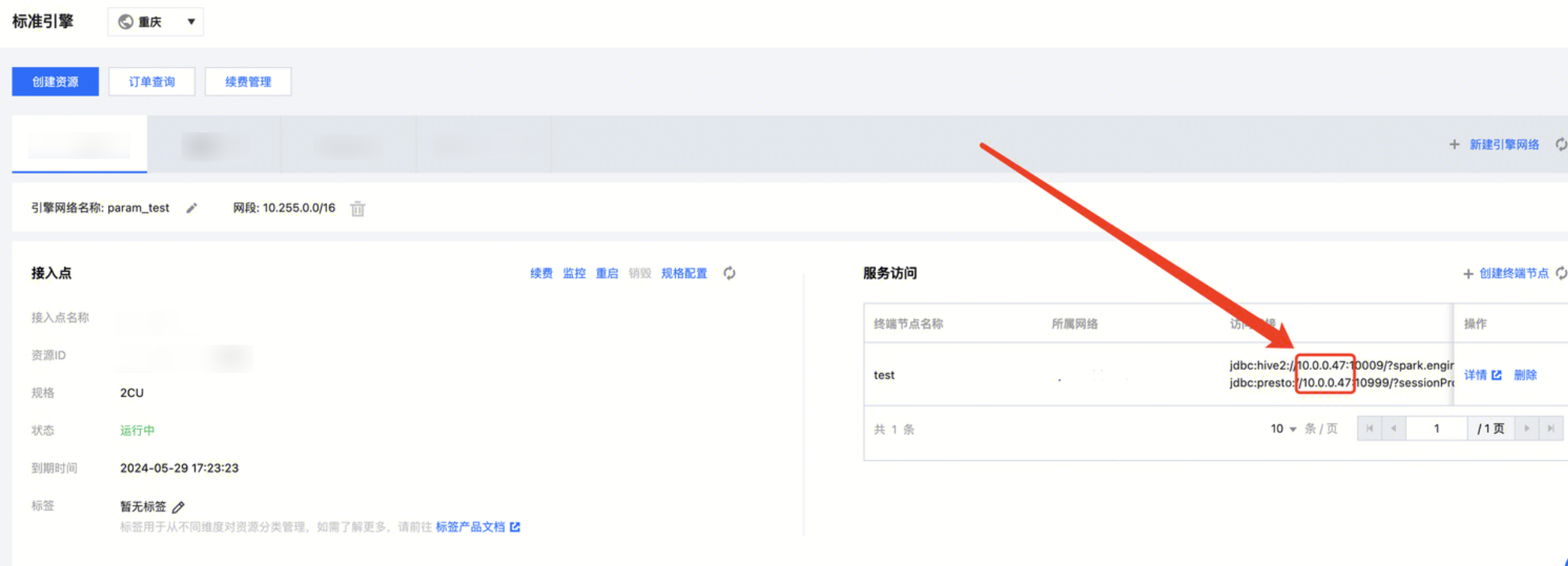

2. 其中 $endPointIP 为 DLC 控制台上打通终端节点后生成的内网 IP,如下所示:

3. 配置完成后,即可以通过步骤2中创建的 NAT 网关上面绑定的弹性公网 IP 访问标准引擎并提交任务。

文档反馈